Se preferir, ouça esse artigo em formato podcast:

Introdução

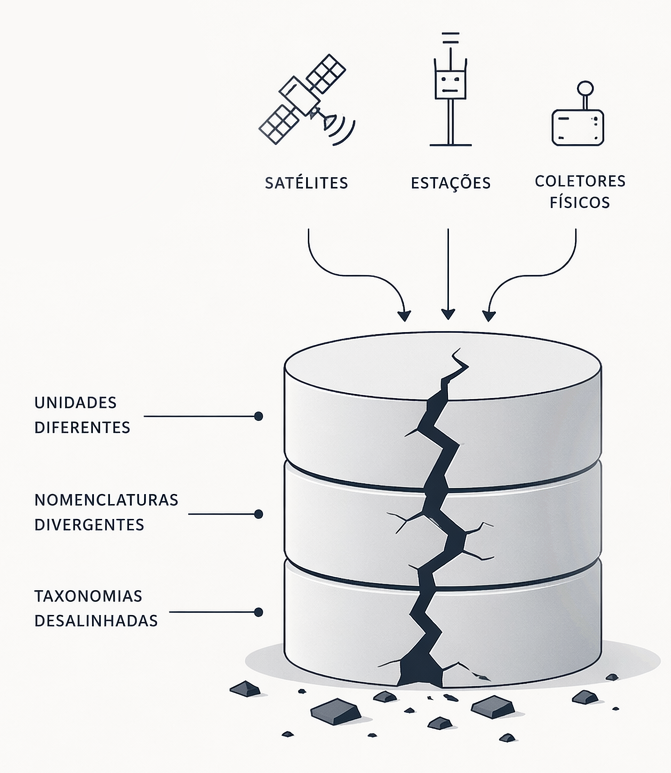

A percepção de que havia um problema crítico na forma como os dados científicos eram tratados veio diretamente da prática. Atuando como pesquisador independente e especialista convidado em projetos como o CAIPORA, percebi que a pluralidade de informações buscada pelos grupos — vindas de satélites, coletores físicos e estações — apresentava formatos totalmente distintos. Mesmo com uma lógica de agrupamento organizada, não sobrava tempo para as pessoas pararem e normalizarem esses dados; unidades não batiam e as taxonomias eram divergentes.

Sem uma governança dedicada a esse processo, entendi que o projeto já nascia com uma inconsistência nas informações básicas, o que chamo de começar o trabalho sobre uma “base rachada”. Foi essa lacuna que me motivou a estruturar a DataShipper, atuando em frentes que tratam e normalizam dados para facilitar o uso pelo time acadêmico, garantindo que essa metodologia gere escalabilidade em diferentes tecnologias e ecossistemas.

Abaixo, apresento uma análise dos desafios enfrentados e como a DataShipper busca resolvê-los.

1. A Identificação da “Base Rachada” no Início da Pesquisa

O primeiro grande desafio da ciência moderna é a fragmentação das fontes. Em projetos de larga escala, cada cientista assume a responsabilidade por sua especialidade, mas a ausência de uma governança centralizada faz com que a normalização seja negligenciada. O resultado é uma base de informações fundamentalmente problemática antes mesmo do início do desenvolvimento científico.

O que realmente faz diferença para um projeto que visa alcance acadêmico e social não é apenas a organização básica, mas uma lógica de normalização que conecte esses dados ao mundo real. Dentro do leque de serviços e frentes da DataShipper, trabalhamos para que essa normalização seja o alicerce que permite ao time acadêmico focar no que importa, garantindo a integridade da pesquisa desde a origem.

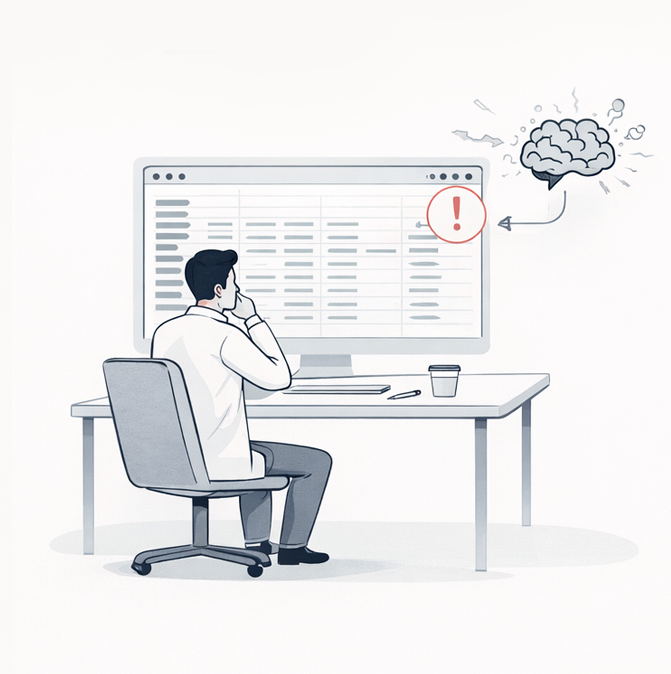

2. O “Salto de Fé”: Os Obstáculos Computacionais e Cognitivos

A transição do dado bruto para uma solução concreta enfrenta barreiras severas, começando pelo desafio computacional de processar e armazenar terabytes de informação. Somado a isso, existe o limite cognitivo de interpretar dados brutos sem interfaces que os traduzam de maneira eficiente.

Essa dificuldade empurra o corpo acadêmico para uma validação baseada apenas em amostras ou “pedaços”, resultando em um perigoso “salto de fé”. É importante destacar que, embora o método científico garanta a integridade do resultado final, esses pequenos “saltos de fé” nada mais são do que a escolha de seguir adiante com o risco latente de ter que refazer. A ausência de uma sistemática universal obriga o pesquisador a trabalhar meses para só então descobrir, por um resultado inesperado, que a informação inicial não era precisa. A DataShipper visa justamente substituir esse risco pela capacidade de garantir a integridade dos dados de antemão.

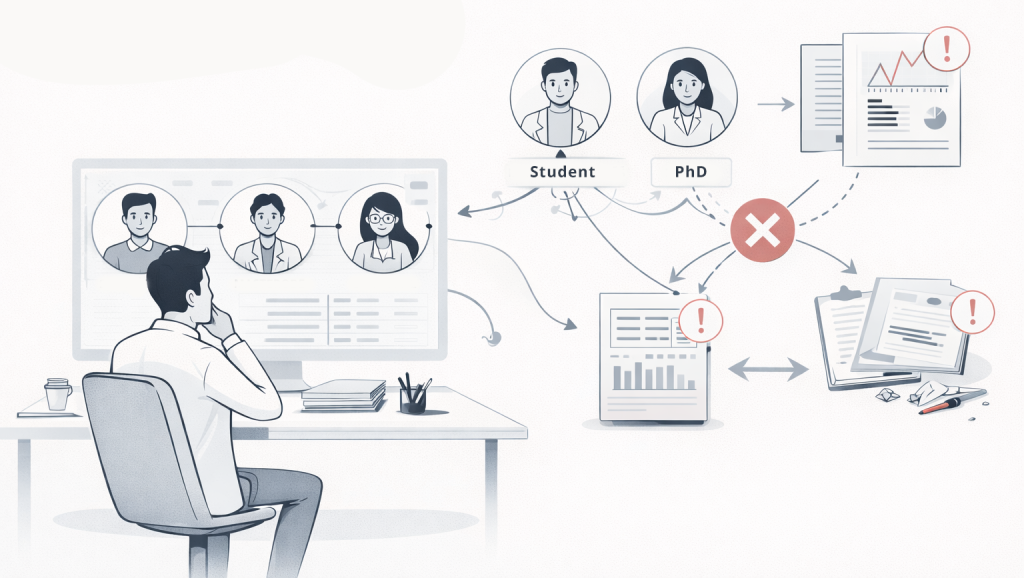

3. A Dor da Coordenação e o Risco do Retrabalho

No nível gerencial, o coordenador acadêmico enfrenta o desafio de equilibrar qualidade e velocidade enquanto gerencia equipes heterogêneas, desde o aspecto multidisciplinar até o fato de alguns projetos terem desde bolsistas de iniciação científica a doutorados experientes. Validar o que cada cientista traz para o projeto exige lidar com dados brutos para entender sua integridade, uma tarefa exaustiva que muitas vezes leva ao retrabalho. Há uma sensação de que a parte fundamental da liderança, que é promover a evolução dos conhecimentos do grupo, compete com trivialidades que somam maior grandeza.

Como uma de suas frentes de auxílio à coordenação, a DataShipper garante a integridade e a normalização dos dados como uma premissa do projeto. Isso é realizado por meio de soluções inteligentes (como a “Data Bridge”) e uma metodologia de integração e onboarding dos pesquisadores. Essa abordagem elimina a preocupação sobre a funcionalidade do dado e evita que erros descobertos tardiamente comprometam o projeto. Ao assegurar que as entregas do time estejam integradas entre si, aumentamos a confiança na equipe e reduzimos a insegurança do coordenador quanto à integridade da metodologia científica aplicada.

4. Atuando na raiz do problema: O Diferencial da DataShipper

A essência da nossa atuação é lidar com a radicalidade dos problemas. Entendemos que se uma inconsistência obriga o pesquisador a voltar e refazer o trabalho, a falha não reside na descoberta científica, mas na sistematização e consistência desses dados.

Uma das frentes fundamentais da DataShipper é criar dispositivos capazes de deixar esses dados organizados e padronizados, devolvendo a confiança necessária ao time acadêmico. Nossa metodologia garante que os dados sejam distribuídos de forma normalizada e inseridos em tecnologias escaláveis, permitindo um consumo dinâmico, produtivo e humanizado. Isso assegura que a pesquisa possa evoluir no longo prazo, conectando-se com outros ecossistemas. Trabalhando em paralelo com o time do projeto, garantimos que o dado percorra o caminho com integridade até chegar na ponta final para a sociedade, fazendo uma diferença real.